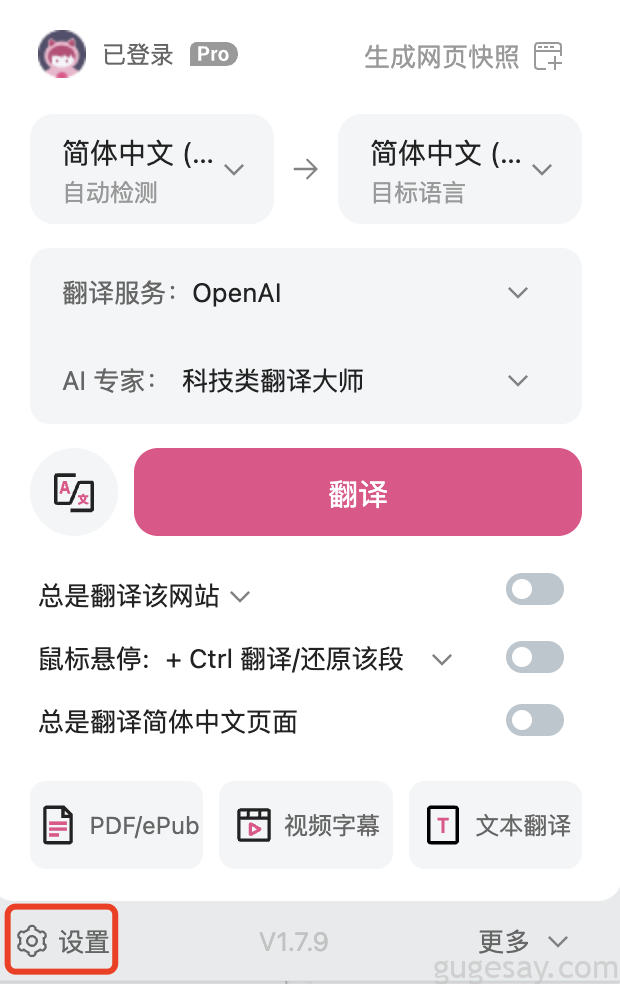

既然本地部署了Ollama,沉浸式翻译这款神器插件,也可以使用本地的大模型进行更加优化的翻译了,首先点击左下角设置:

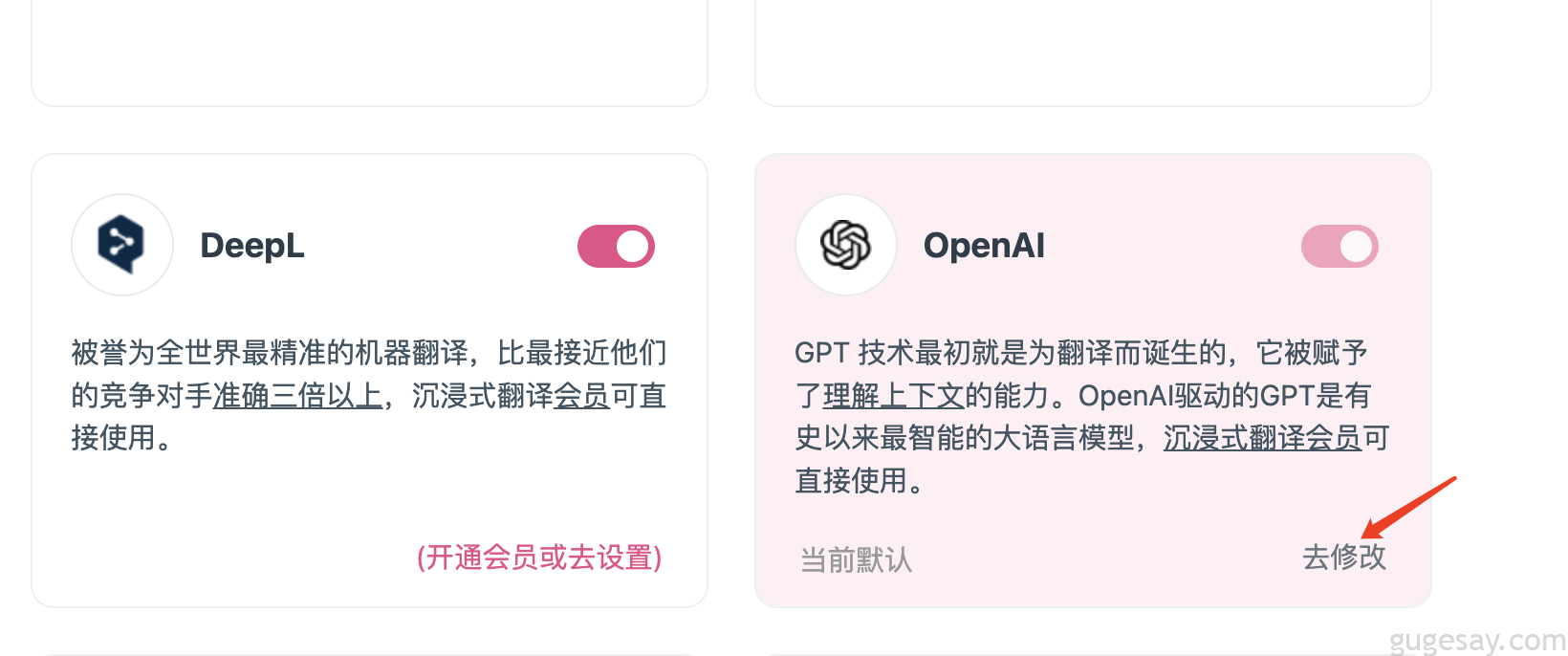

接着选中OpenAI,点击“去修改”:

选择“自定义API Key”,APIKEY中填写“ollama”,模型选择你“心仪”的大模型:

然后在自定义 API 接口地址,填写“http://127.0.0.1:11434/v1/chat/completions”

然后回到最上方的右上角,点击“点此测试服务”:

如果显示403错误的话,可以使用以下方式解决:

-

Macos:

输入launchctl setenv OLLAMA_ORIGINS "*"后启动ollama APP -

Linux:

输入OLLAMA_ORIGINS="*" ollama serve -

Windows:

控制面板-系统属性-环境变量-用户环境变量中新建2个环境变量:变量名OLLAMA_HOST变量值设置为0.0.0.0,变量名OLLAMA_ORIGINS变量值设置为*,再启动App。

测试,出现“验证成功”就表示成功了。